Curso para os Bispos reflete sobre a transmissão da fé em um mundo em transformação

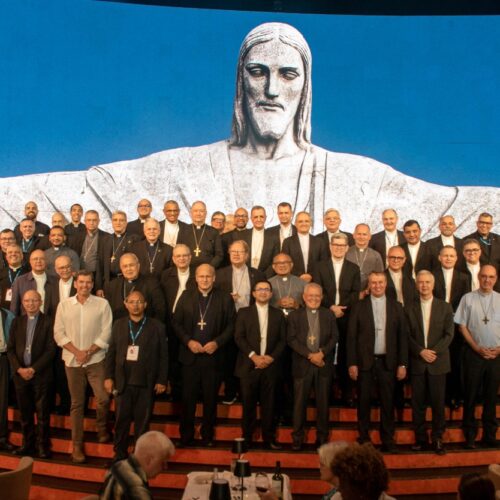

A Arquidiocese de São Sebastião do Rio de Janeiro sediou, na última semana de janeiro, a 35ª edição do tradicional Curso para os Bispos, realizado entre os dias 26 e 31 de janeiro. Com o tema “A transmissão da fé num mundo em transformação”, o encontro reuniu bispos de diversas dioceses do Brasil para dias de estudo, partilha de experiências e convivência fraterna.

O curso, que acontece anualmente desde 1990, tem como objetivo oferecer aos bispos um espaço de formação permanente, ajudando-os a refletir sobre os desafios do pastoreio no contexto atual, marcado por rápidas mudanças culturais, sociais e tecnológicas.

O curso, que acontece anualmente desde 1990, tem como objetivo oferecer aos bispos um espaço de formação permanente, ajudando-os a refletir sobre os desafios do pastoreio no contexto atual, marcado por rápidas mudanças culturais, sociais e tecnológicas.

Segundo o arcebispo do Rio de Janeiro, Dom Orani Tempesta, o tema escolhido dialoga diretamente com a realidade vivida pela Igreja hoje. “Vivemos profundas transformações, tanto no campo tecnológico quanto nos valores e nas formas de relacionamento. A missão da Igreja permanece a mesma: anunciar o Evangelho. O desafio é encontrar caminhos para que essa transmissão da fé aconteça de forma fiel e compreensível para as pessoas do nosso tempo”, afirmou.

Dom Orani destacou ainda que o curso não tem caráter deliberativo nem pretende produzir documentos. “Este é um tempo de escuta, reflexão e partilha. Não buscamos conclusões fechadas, mas aprofundar temas que ajudem cada bispo a discernir melhor sua missão em sua própria diocese”, explicou.

Realizado tradicionalmente no mês de janeiro, período de férias, o curso tem participação aberta aos bispos que desejam integrar o encontro, incluindo bispos eméritos. A proposta é unir estudo, convivência e descanso, fortalecendo o sentido de colegialidade episcopal.

Realizado tradicionalmente no mês de janeiro, período de férias, o curso tem participação aberta aos bispos que desejam integrar o encontro, incluindo bispos eméritos. A proposta é unir estudo, convivência e descanso, fortalecendo o sentido de colegialidade episcopal.

“O encontro favorece a fraternidade entre os bispos. É um momento importante para trocar experiências, rezar juntos e também renovar as forças para o ano pastoral que se inicia”, ressaltou Dom Orani.

A iniciativa teve origem com o Cardeal Eugenio de Araújo Sales, então arcebispo do Rio de Janeiro, em parceria com seu bispo auxiliar, Dom Karl Josef Romer. A primeira edição contou com a presença do então cardeal Joseph Ratzinger, futuro Papa Bento XVI. Mesmo durante a pandemia da Covid-19, o curso foi mantido, ocorrendo de forma online nos anos de 2021 e 2022.

Nesta edição, participaram como conferencistas Dom Carlo Maria Polvani, secretário do Dicastério para a Cultura e a Educação; Pe. Dr. Giuseppe Tanzella-Nitti, pesquisador do Observatório do Vaticano; Pe. Dr. Riccardo Bollati, do Dicastério para a Doutrina da Fé; Pe. Luiz Henrique Brandão de Figueiredo, da PUC Goiânia; e o Prof. Dr. Marcelo Alves, da PUC-Rio, especialista em Comunicação Social.

As reflexões abordaram, entre outros temas, o impacto da inteligência artificial, o uso das redes sociais, os novos meios de comunicação e os desafios da evangelização no século XXI.

Para Dom Orani, a escolha do início do ano para o curso é estratégica. “O que é refletido aqui pode acompanhar o trabalho pastoral ao longo de todo o ano. São sementes que cada bispo leva para dialogar com seus presbíteros, religiosos, consagrados e agentes de pastoral”, destacou.

O Curso para os Bispos reafirma a preocupação do episcopado brasileiro e latino-americano com o futuro da Igreja e com a missão de anunciar o Evangelho em uma sociedade em constante transformação, mantendo viva a fé e fortalecendo a comunhão e a unidade entre os pastores.